本日のAI業界は、倫理とセキュリティに関する課題と、技術革新の双方で大きな動きを見せています。OpenAIはユーザーの安全を強化する新機能を導入し、欧州連合(EU)はAI法改正を通じて倫理的なAI利用を推進。一方で、企業内でのシャドーAI利用による情報漏洩リスクや、AI導入による人員削減といった経済的影響も顕在化しています。技術面では、AIの内部メカニズムを解明する研究が進展しています。

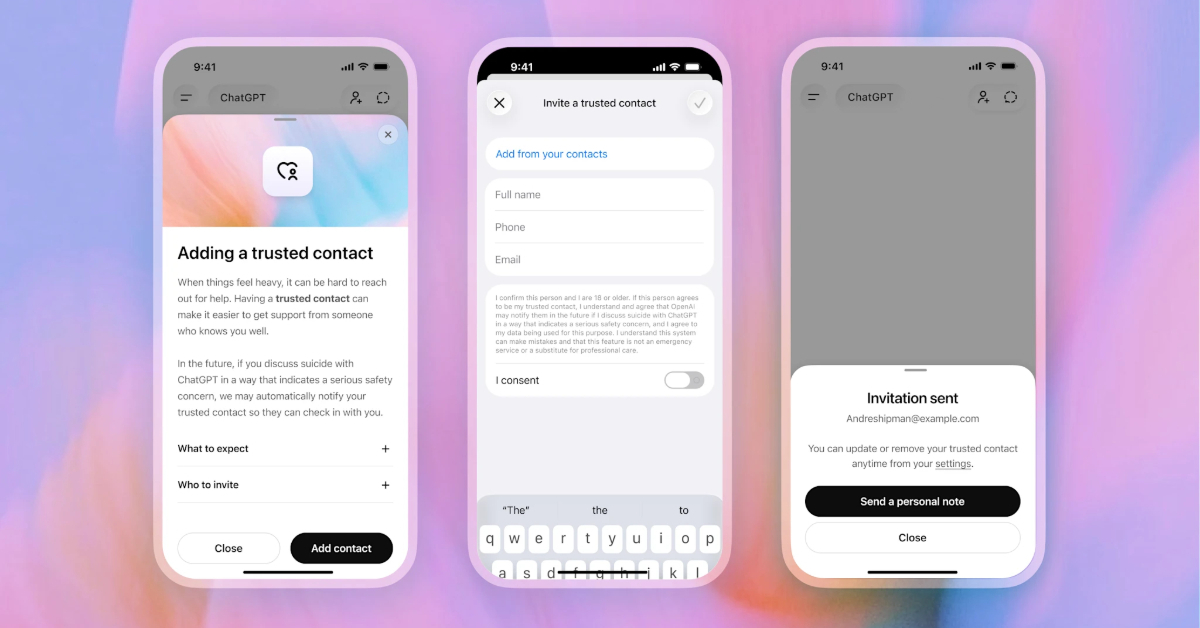

ChatGPTに緊急連絡先機能「Trusted Contact」が登場

出典: ITmedia AI+

OpenAIは、ChatGPTにユーザーのメンタルヘルスに関する懸念が生じた際、信頼できる人物に通知する安全機能「Trusted Contact(トラステッド・コンタクト)」を追加しました。この機能は、18歳以上の個人ユーザーが対象で、AIと人間が協力して深刻なリスクを検知した場合にのみ、ユーザーが事前に指定した連絡先に安否確認を促すものです。会話の詳細は通知されず、現実世界でのサポートへの橋渡しを目的としています。

考察: AIがユーザーの精神状態を推測し、現実のセーフティネットと連携する試みは、AIサービスの倫理的利用と責任に関する重要な一歩です。ユーザーのプライバシーを尊重しつつ、緊急時の介入を可能にするこのアプローチは、今後のAI安全機能の設計において参考になるでしょう。

出典: ITmedia AI+

OpenAIは、ChatGPTにユーザーのメンタルヘルスに関する懸念が生じた際、信頼できる人物に通知する安全機能「Trusted Contact(トラステッド・コンタクト)」を追加しました。この機能は、18歳以上の個人ユーザーが対象で、AIと人間が協力して深刻なリスクを検知した場合にのみ、ユーザーが事前に指定した連絡先に安否確認を促すものです。会話の詳細は通知されず、現実世界でのサポートへの橋渡しを目的としています。

考察: AIがユーザーの精神状態を推測し、現実のセーフティネットと連携する試みは、AIサービスの倫理的利用と責任に関する重要な一歩です。ユーザーのプライバシーを尊重しつつ、緊急時の介入を可能にするこのアプローチは、今後のAI安全機能の設計において参考になるでしょう。

管理職の4割が「シャドーAI」に機密情報を入力する実態

出典: ITmedia AI+

GRASグループの調査により、企業内で承認されていない「シャドーAI」の利用が拡大し、特に管理職層の4割が機密情報をこれらAIに入力していることが明らかになりました。この傾向は、危険性を認識しつつも業務効率化への強いニーズからAIツールを使用している現状を示唆しています。企業が把握していないAI利用は、情報漏洩やコンプライアンス違反のリスクを高めています。

考察: 生成AIの急速な普及は、企業のセキュリティガバナンスに新たな課題を突きつけています。従業員の業務効率化ニーズと情報セキュリティとのバランスを取りながら、安全かつ効果的なAI利用ガイドラインの策定と啓蒙が喫緊の課題と言えるでしょう。

出典: ITmedia AI+

GRASグループの調査により、企業内で承認されていない「シャドーAI」の利用が拡大し、特に管理職層の4割が機密情報をこれらAIに入力していることが明らかになりました。この傾向は、危険性を認識しつつも業務効率化への強いニーズからAIツールを使用している現状を示唆しています。企業が把握していないAI利用は、情報漏洩やコンプライアンス違反のリスクを高めています。

考察: 生成AIの急速な普及は、企業のセキュリティガバナンスに新たな課題を突きつけています。従業員の業務効率化ニーズと情報セキュリティとのバランスを取りながら、安全かつ効果的なAI利用ガイドラインの策定と啓蒙が喫緊の課題と言えるでしょう。

OpenAIがAPI向けに新音声インテリジェンス機能を提供開始

出典: TechCrunch AI

OpenAIは、APIを通じて新たな音声インテリジェンス機能の提供を開始しました。この機能は、顧客サービスシステムでの活用が期待されるだけでなく、教育やクリエイタープラットフォームを含む幅広い分野での応用が可能であるとOpenAIは説明しています。これにより、開発者はより高度な音声処理能力を持つアプリケーションを構築できるようになります。

考察: 音声入力・出力の精度向上と機能拡充は、AIアシスタントや対話型AIインターフェースのユーザビリティを飛躍的に高めます。特にAPI提供は、多様な産業におけるAI活用の障壁を下げ、新たなユースケースの創出を加速させるでしょう。

出典: TechCrunch AI

OpenAIは、APIを通じて新たな音声インテリジェンス機能の提供を開始しました。この機能は、顧客サービスシステムでの活用が期待されるだけでなく、教育やクリエイタープラットフォームを含む幅広い分野での応用が可能であるとOpenAIは説明しています。これにより、開発者はより高度な音声処理能力を持つアプリケーションを構築できるようになります。

考察: 音声入力・出力の精度向上と機能拡充は、AIアシスタントや対話型AIインターフェースのユーザビリティを飛躍的に高めます。特にAPI提供は、多様な産業におけるAI活用の障壁を下げ、新たなユースケースの創出を加速させるでしょう。

米Coinbase、AIの影響で約14%の人員削減を発表

出典: ITmedia AI+

米国の暗号資産取引所Coinbase(コインベース)は、全従業員の約14%にあたる人員を削減すると発表しました。同社はこの人員削減の理由として、AI技術の導入による働き方の変化を挙げています。AIによって特定の業務の自動化が進み、従来必要とされていた人材の一部が不要になったと判断したものです。

考察: AIによる業務効率化が現実の人員配置に与える影響が具体的に示された事例です。これは、AIが産業構造や雇用形態を根本的に変革する可能性を示しており、企業はAI導入に伴う戦略的な人材計画が求められるようになります。

出典: ITmedia AI+

米国の暗号資産取引所Coinbase(コインベース)は、全従業員の約14%にあたる人員を削減すると発表しました。同社はこの人員削減の理由として、AI技術の導入による働き方の変化を挙げています。AIによって特定の業務の自動化が進み、従来必要とされていた人材の一部が不要になったと判断したものです。

考察: AIによる業務効率化が現実の人員配置に与える影響が具体的に示された事例です。これは、AIが産業構造や雇用形態を根本的に変革する可能性を示しており、企業はAI導入に伴う戦略的な人材計画が求められるようになります。

EU AI法、性的画像の無許可AI生成禁止で暫定合意

出典: ITmedia AI+

欧州連合(EU)は、AI法(AI Act)の修正案に関して暫定的な合意に至り、その中で特に許可なく個人の性的画像を生成するAIの利用を禁止する条項が含まれました。これは、AIの利用に関する一部規制を緩和する一方で、社会的に特にデリケートな問題に対しては厳格な法的枠組みを設ける姿勢を示しています。生成AIの倫理的な開発と利用に向けた、国際的な規制の動きとして注目されます。

考察: 生成AIがもたらす倫理的課題の中でも、ディープフェイクなどの悪用に対する規制は急務であり、今回のEUの合意は具体的な法的措置として先行的な役割を果たすでしょう。AI開発者やサービス提供者は、このような規制の動向を注視し、倫理的ガイドラインと法的要件への準拠を徹底する必要があります。

出典: ITmedia AI+

欧州連合(EU)は、AI法(AI Act)の修正案に関して暫定的な合意に至り、その中で特に許可なく個人の性的画像を生成するAIの利用を禁止する条項が含まれました。これは、AIの利用に関する一部規制を緩和する一方で、社会的に特にデリケートな問題に対しては厳格な法的枠組みを設ける姿勢を示しています。生成AIの倫理的な開発と利用に向けた、国際的な規制の動きとして注目されます。

考察: 生成AIがもたらす倫理的課題の中でも、ディープフェイクなどの悪用に対する規制は急務であり、今回のEUの合意は具体的な法的措置として先行的な役割を果たすでしょう。AI開発者やサービス提供者は、このような規制の動向を注視し、倫理的ガイドラインと法的要件への準拠を徹底する必要があります。

Anthropic、自然言語オートエンコーダーでClaudeの「思考」をテキスト化

出典: Hacker News

Anthropic(アンソロピック)は、大規模言語モデル(LLM)Claude(クロード)の内部状態、すなわち「思考」を自然言語のテキストとして解釈・可視化する「自然言語オートエンコーダー」に関する研究を発表しました。この技術は、モデルがどのように情報を処理し、特定の反応を示すかをより深く理解するためのものです。これにより、AIの信頼性や安全性を高める上での重要な知見が得られると期待されています。

考察: LLMの「ブラックボックス問題」に対する解明の試みとして、この研究は非常に重要です。モデルの内部メカニズムを可視化することで、AIの挙動を予測し、偏見や不適切な出力を特定しやすくなるため、より安全で説明可能なAIシステムの開発に貢献するでしょう。

出典: Hacker News

Anthropic(アンソロピック)は、大規模言語モデル(LLM)Claude(クロード)の内部状態、すなわち「思考」を自然言語のテキストとして解釈・可視化する「自然言語オートエンコーダー」に関する研究を発表しました。この技術は、モデルがどのように情報を処理し、特定の反応を示すかをより深く理解するためのものです。これにより、AIの信頼性や安全性を高める上での重要な知見が得られると期待されています。

考察: LLMの「ブラックボックス問題」に対する解明の試みとして、この研究は非常に重要です。モデルの内部メカニズムを可視化することで、AIの挙動を予測し、偏見や不適切な出力を特定しやすくなるため、より安全で説明可能なAIシステムの開発に貢献するでしょう。

今日のまとめ

本日のAIニュースは、AIの急速な進化がもたらす光と影を浮き彫りにしました。OpenAIによるユーザー安全機能の強化やEUのAI法改正は、倫理的かつ責任あるAIの発展に向けた重要なステップです。一方で、シャドーAI利用によるセキュリティリスクや、AIによる人員削減といった課題も顕在化しています。こうした状況の中、Anthropicの研究はAIの透明性を高める試みであり、今後のAIシステムの信頼性向上に貢献すると期待されます。

関連書籍・学習リソース

最高の答えを引き出す 生成AIプロンプトの技法

プロンプトエンジニアリングの技法を体系化した実践書 (電子書籍)

1,980円

楽天で見る →

実践Claude Code入門 — 現場で活用するためのAIコーディングの思考法

Claude Codeを現場開発で使いこなす思考法と実践ノウハウ

3,300円(税込・送料無料)

楽天で見る →

中堅・中小企業のためのAI導入・活用の教科書

規模別・段階別のAI導入ステップと活用事例

2,420円(税込・送料無料)

楽天で見る →※ 本記事には Amazon アソシエイト・楽天アフィリエイト・A8.net 等のアフィリエイト広告が含まれる場合があります。リンクから商品・サービスが購入された場合、紹介料を受け取ることがあります。